理论上,时代的进步会埋葬掉一批旧职业,也会催生一批新职业。

生活在21世纪的人们恐怕很难想象,100年前居然有打字员这个职业;同样的,100年后,人们可能也很难想象在2020年前后,互联网上曾经出现过一大批专门鉴别黄色、暴力、恐怖等违规内容的内容审核员。

鉴黄师这个说法对很多人来说不陌生,传说中的高薪和“福利”曾让不少人羡慕。以某个职业作为概括和戏谑的方法,一直流行于酷爱标签化讨论的中文社交媒体中,鉴黄师这个职业表面听上去心潮澎湃,甚至还会令人浮想联翩,认为自带工作福利buff。但事实上恰恰相反,鉴黄师的工作只能用繁重和辛苦来形容:每天做的都是重复,机械工作,不但压力巨大,并且还要承受巨大的心里阴影。

一般来说,鉴黄师鉴别的内容主要是视频、文字和图片。不同平台对内容审核员的要求不同,文字类内容一个人一天审核几万条;图片则是几万张;视频类大约1000到2000条左右,这是普通审核员一天的工作量。但大部分内容并非人们想象中的充满色情暴力和凶杀,很多时候只是一些错误、遗漏和违规。比如说有一些标题和内容严重不符合的电影、短视频;比如出现粗话脏话的动画片,审核员要做的,是每天将这些违规的网址、物料进行一个汇总,提交并等待处理。

图来自《宅男们真的在这里找到了“天堂”吗?---访AI鉴黄师姜泽荣》

真正的鉴黄师,一般是在直播平台和短视频居多,他们一天要盯着几百个直播房间,和各式各样的老司机打交道。现在主播都很聪明,绝对不会出现裸体、啪啪啪这样的画面,这样还没等鉴黄师发现,就直接屏蔽封号了。老司机们一般都是“不小心”胸口的扣子开了,或者忽然口播一个QQ号,加QQ送福利,这就需要内容审核员的细心和耐心了。

简而言之,鉴黄师的工作每天就是和内容打交道,发现并揪出那些可能存在风险和隐患的图片、文字、视频。像快手、抖音、今日头条、微博、映客等短视频、社交媒体、直播平台,对内容审核员的需求极大。

然而,鉴黄师和他背后庞大的审核团队,在未来两三年内,恐怕就要成为历史了。

鉴黄师失业,本质上还是AI太发达了

为什么鉴黄师会失业?本质上有两个原因:一是审核的内容和数量实在太多了,并且越来越呈现复杂化,多样化的趋势,都由人来搞,各种成本太高了;二是AI的发展速度太快,已经可以取代绝大多数鉴黄师的工作。

以百度为例,根据百度之前公布《2017年度信息安全综合治理报告》数据显示,百度全年处置有害信息高达451.2亿余条。色情类占比高达68%,制假贩假类、赌博类紧随其后位列前三,占比分别为8.6%和7.2%。

除了自然搜索信息,广告物料违规审查也很重要。谷歌2017年在全球范围内处理了32亿条不良广告,比2016年增加近一倍;百度2017年处理的量级也达到21.3亿条。

像谷歌、百度这样的公司,面对每天以亿级的内容审核压力,完全靠人力是根本行不通的。而且搜索公司需要面对的信息审核,不仅仅是网页信息那么简单,除了网页之外,用户评论、聊天内容、网络文字、注册信息等文本内容也是安全问题的重灾区。可以这么说,只要有用户UGC的地方,都需要内容审核的接入。而现在网民的数量已经达到8亿了,任何人都可以在抖音、微博、喜马拉雅、今日头条上随意注册账号,发表文章或评论,上传视频,这无疑大大加大了审核的难度。除了视频之外,还有音频、还有问答、还有SNS、还有跟帖等等。

而利用人工智能的深度学习技术,通过大规模的样本训练,可以一站式的监测识别文本中夹杂的色情信息,恶意推广URL、低俗辱骂、政治敏感、暴恐违禁违法等垃圾内容,从而自动化、智能化判断一段文本内容是否规范,极大减少人工审核工作量,降低内容风险。

这就是AI介入风控的必要性和价值所在。

事实上,违规内容和内容审核平台也在互相斗法,简单的裸体,敏感部位露出这种傻瓜式的违规信息已经很少了,更多的是一些“意味深长”的内容。比如tinder同城约会这种信息,照片完全不露点,但明眼人一看就知道是什么,这就考验算法的能力。

举个例子,像泳装照,同样的照片,如果出现在电商平台上,就属于正常的内容展示。但如果出现在一些带有“同城”“约会”这样暗示字眼的信息网页上,就是违规内容。这需要算法根据文本和图片的监测情况进行综合的判定。

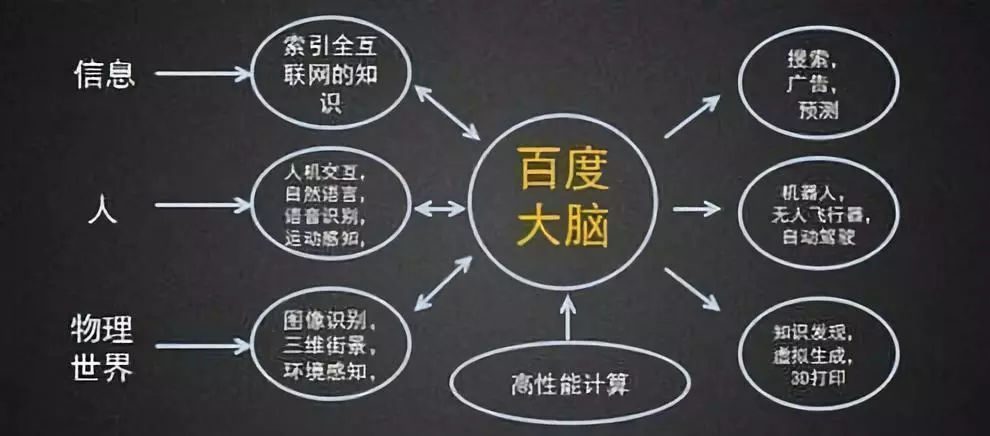

现在百度的“最强审核员”已经能够做到图像审核、广告过滤、恶心图像识别和图片质量检测。举例来说,像上传的头像涉黄涉暴涉敏,或者含文字或二维码广告等情况,一方面影响平台其他用户的使用感受;另一方面也会给平台带来违规风险,而大量的人工审核费时费力,标准不一。

百度大脑则可以利用接口对用户的头像进行审核,整个审核过程标准统一,简单高效,比人工要高出很多倍。比如虚假信息泛滥的医疗广告,一直是违规内容的重灾区,通过引入AI,百度2017年打击虚假医疗广告6000万条,在医疗广告整治方面,百度风控系统全年屏蔽了近23万个非法医疗类词汇,大大减少了非法医疗保健广告的危害。

比较有意思的是,全球最大的色情网站,pornhub也在学习如何利用人工智能学习识别色情信息,比如以后用户上传了一则视频,系统可以根据数据库的明星数据,识别出这是哪一个色情明星,甚至能根据不同的姿势和场景,打不同的标签。pornhub表示,未来一年内,计划扫描全部500万部视频,进行分类,例如视频是否在户外拍摄(如果是这样,那么将添加至“公共”分类),或者演员是否是金发女郎。

图来自《出VR成人,搞AI鉴黄师,我们和全世界最大成人网站的人工智能聊了聊》

这意味着无论是正向的审核识别,还是逆向的智能色情——将任何用户的上传的视频都能进行智能化的编码,人工正在逐渐失去主导地位。

AI最终会取代人工吗?

既然AI可以进化到能处理99%的违规信息,那么未来是否AI会彻底取代人工呢?

答案是否定的。

有这么几个原因。

首先,内容审核作为一项长期存在的需求,审核的数量只会增加不会减少,完全靠人工根本不现实,所以都是算法+人工配合。以百度为例,去年拒绝不良广告数21.3亿条,这相当于平均每分钟要处理4000余条不良广告。而最近系统升级后,每分钟处理条数达到了4500条。这个基数还在不断增大,肯定要加强机器的比例,不管是谷歌还是百度,都是如此。但不同之处在于,过去图片30%的内容是靠机器审核,但70%的内容是靠人工,但随着AI技术的发展,这个比例可以变成90%的内容靠机器,10%的内容靠人工。

其次是,人和AI的关系正在发生变化,过去鉴黄师的主要任务,就是识别色情信息,人是一线的。但未来内容审核的模式,会变成机器在一线,人负责最终的把控和管理,机器是辅助人的,一个人就可以负责一个频道和品类,大大提升了工作的效率,最终会变成类似翻译和翻译软件之间协同工作的模式——所有内容都是机器翻译,人工是最后把关,也就是检查语法是否有错误、语序和段落的调整和修改。

事实上,人工和AI的微妙关系在于,即便是AI能够做到99.99%的识别率,但人工依然是最后一道保险栓,正如汽车可以研制出无人驾驶,但所有汽车刹车都是采用物理制动一样,守门人监管的意义在于,并不是为了确保那0.01%的误差,而是为了达到人和AI相互配合的完美境界。

·以及·

最后的一个问题,那些失业的鉴黄师怎么办。

事实上,内容审核员的意义在于确保内容的安全和健康,如果你读过《资源革命》这本书,就知道资源的枯竭并不会造成某个行业的急剧下降,反而会极大的促进这个行业发展,因为人们会想尽办法研究替代方案,从而衍生出更多的需求和工种。从这个方面来看,鉴黄师只是整个互联网过渡和妥协的产物。鉴黄师消失的一小步,是互联网进步的一大步。

作者 唆麻 用独特的角度解读互联网世界正在发生的事情

声明:本文内容和图片仅代表作者观点,不代表蓝时代网立场。蓝时代 » 职业鉴黄师,AI可能要让你们马上失业了

蓝时代

蓝时代